Die ethischen Herausforderungen der Künstlichen Intelligenz: Fehlinformationen und Voreingenommenheit

Künstliche Intelligenz (KI) hat in den letzten Jahren erhebliche Fortschritte gemacht und ist mittlerweile tief in unseren Alltag integriert. Doch mit ihren Vorteilen kommen auch Herausforderungen, insbesondere in den Bereichen Fehlinformationen und Voreingenommenheit. Schauen wir einmal auf die ersten, wichtigsten ethischen Fragestellungen und wie wir ihnen begegnen können.

Fehlinformationen und die Rolle der KI

Mit der Verbreitung von KI-gestützten Tools ist es einfacher denn je, realistisch wirkende Bilder, Videos oder Audiodateien zu erstellen und zu verbreiten. Dies hat zu einem drastischen Anstieg von Mythen und Desinformationen geführt. So soll sich seit der Einführung von ChatGPT hat die Anzahl bild- und videobasierter Falschinformationen verdoppelt haben.

Was bedeutet das für uns Nutzer?

„Sehen und Hören“ kann und darf nicht mehr automatisch „Glauben“ bedeuten. Als Nutzer sozialer Medien sollten wir uns angewöhnen, Informationen zu überprüfen, bevor wir sie weiterleiten. Denn unkritisches Teilen trägt zur Verbreitung von Fehlinformationen bei.

Doch auch Unternehmen sind betroffen: Mythen und Falschmeldungen über Unternehmen und deren CEOs nehmen zu. Viele Firmen überwachen jedoch weder aktiv Desinformationen noch Deepfakes oder Fake News. Dies stellt ein erhebliches Risiko dar.

Technische Lösungen zur Authentifizierung

Um dem entgegenzuwirken, setzen bereits rund 3.000 Marken auf die C2PA-Anmeldeinformationen zur Inhaltsauthentizität. Dieser kostenlose Code kann in Inhalte eingebettet werden, um deren Echtheit zu gewährleisten.

Was ist C2PA?

C2PA (Coalition for Content Provenance and Authenticity) ist eine Initiative zur Bekämpfung von Fehlinformationen, die von Unternehmen wie Adobe, Microsoft und Intel ins Leben gerufen wurde. Ihr Ziel ist es, eine standardisierte Methode zur Kennzeichnung von Inhalten zu schaffen, die nachweist, wer einen bestimmten digitalen Inhalt erstellt hat und ob er manipuliert wurde. Durch diese Technologie können Medienorganisationen, Unternehmen und Einzelpersonen besser nachvollziehen, ob Bilder, Videos oder Texte authentisch sind oder potenziell gefälscht wurden.

Ein weiteres Beispiel ist die Entwicklung von Technologien, die mehrere Datenquellen einbeziehen, um Mythen und Desinformationen schneller zu identifizieren. Es geht tatsächlich um Schnelligkeit, denn Studien zeigen, dass Fehlinformationen sich zehnmal schneller verbreiten als echte Nachrichten. Durch die Implementierung intelligenter Mechanismen kann jedoch verhindert werden, dass sich diese unkontrolliert ausbreiten.

Voreingenommenheit in der KI

KI ist nicht von Natur aus voreingenommen, doch sie spiegelt die Verzerrungen wider, die in den Daten enthalten sind, mit denen sie trainiert wurde.

So ist es eine skurrile Eigenart vieler KI-Modelle, dass die Zahl 42 überhäufig als Zufallszahl genannt wird. Das liegt an den Quellen aus der Popkultur und der ungebrochenen Beliebtheit des Romans Per Anhalter durch die Galaxis.

Aber auch Apple brachte ein KI-gestütztes Finanzprodukt auf den Markt, das heftig kritisiert wurde, weil Frauen systematisch schlechtere Kreditlimits erhielten. Die zugrunde liegenden Trainingsdaten spiegelten Ungleichheiten aus der Vergangenheit.

Unsauberes Datenmaterial führte auf zu einer ethnischen Beeinträchtigung, als in den USA KI-Systeme zur Identifikation von Patienten entwickelt wurden, die zusätzliche Pflege benötigen. Die Algorithmen stuften schwarze Patienten systematisch niedriger ein.

Diese Beispiele verdeutlichen, dass KI nicht bewusst diskriminiert, aber durch verzerrte Daten ungewollte Vorurteile verstärken kann.

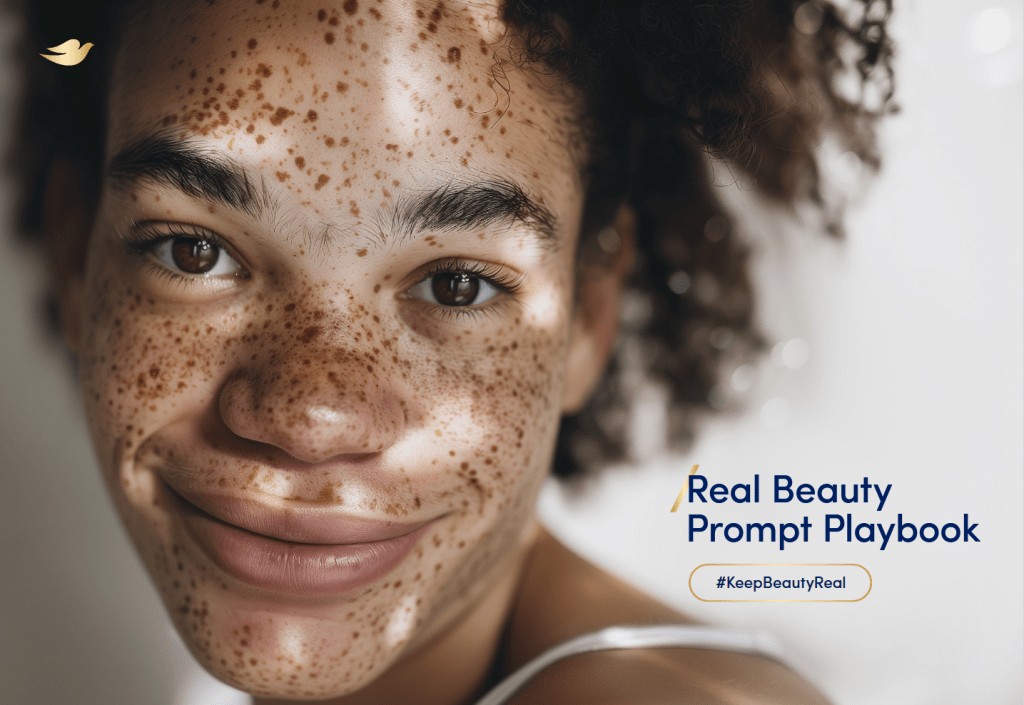

Beispiel: der Dove-Code

Nun wäre ich ja kein Marketingmensch, wenn ich nicht auch ein interessantes Beispiel präsentieren könnte:

Schon vor zwanzig Jahren begann Dove ein Zeichen gegen falsche Schönheitsstandards zu setzen. Auch und gerade in Zeiten von KI bleibt ihre Botschaft bestehen: Schönheit muss echt bleiben. Denn eine von drei Frauen fühlt sich durch das, was sie online sieht, unter Druck gesetzt, ihr Aussehen zu verändern, selbst wenn sie weiß, dass die Bilder gefälscht oder durch KI generiert sind.

Die KI hat grundsätzlich keine Vorstellung von Schönheit im menschlichen Sinne, sondern erstellt schlicht ein Bild aus dem, was wir in der digitalen Welt über Schönheit sagen. Aus diesem Grund will Dove die Definition der KI von Schönheit. Dafür haben sie ein KI-Playbook erstellt, dass man kostenlos hier downloaden kann.

Was sind nun mögliche Gegenmaßnahmen

- Bewusste Datenauswahl: Entwickler müssen sicherstellen, dass Trainingsdaten divers und repräsentativ sind.

- Ethik-Frameworks: Unternehmen wie Anthropic setzen auf Modelle wie das HHH-Framework (Helpful, Honest, Harmless), um KI-Systeme an ethischen Standards auszurichten.

- Transparenz und Kontrolle: Nutzer und Unternehmen sollten Mechanismen entwickeln, um Bias systematisch zu überprüfen und zu korrigieren.

Was ist ein HHH-Framework?

Das HHH-Framework (Helpful, Honest, Harmless) ist ein ethischer Ansatz zur Entwicklung von KI-Systemen, der sicherstellen soll, dass Künstliche Intelligenz hilfreich, ehrlich und unschädlich bleibt.

- Helpful (Hilfreich): KI sollte so gestaltet sein, dass sie den Nutzern wertvolle und relevante Informationen liefert, ohne dabei in Irreführung oder Manipulation abzudriften.

- Honest (Ehrlich): KI-Modelle sollten keine erfundenen oder irreführenden Informationen generieren. Sie sollten transparent kommunizieren, wenn sie etwas nicht wissen oder unsicher sind.

- Harmless (Unschädlich): KI darf keine Inhalte generieren oder Entscheidungen treffen, die schädlich für Individuen oder Gesellschaften sein könnten. Dies betrifft insbesondere Diskriminierung, Voreingenommenheit oder ethisch fragwürdige Inhalte.

Das HHH-Framework wird von Unternehmen wie Anthropic entwickelt und verfeinert, um KI-Systeme ethisch und verantwortungsvoll einzusetzen. Es bietet eine Grundlage für eine faire, transparente und sichere Nutzung von KI-Technologien.

Fazit: Verantwortungsvoller Umgang mit KI

KI bietet natürlich großartige Möglichkeiten, aber bringt auch erhebliche Herausforderungen mit sich. Fehlinformationen und Voreingenommenheit sind zwei der größten ethischen Probleme, die angegangen werden müssen.

- Jeder Einzelne kann zur Lösung beitragen, indem er kritisch hinterfragt, wer eine Information erstellt hat und ob sie durch KI manipuliert worden sein könnte.

- Unternehmen sollten proaktiv gegen Fehlinformationen vorgehen und Technologien zur Inhaltsauthentizität einsetzen.

- KI-Entwickler haben die Verantwortung, Verzerrungen in ihren Modellen zu minimieren und faire, repräsentative Daten zu nutzen.

Nur durch eine bewusste Auseinandersetzung mit diesen Themen kann sichergestellt werden, dass KI eine positive und gerechte Zukunft gestaltet.

Hinterlasse einen Kommentar